Codex 認証を使った OpenAI API 互換サーバーの実装と利用

ローカル環境の Codex の認証情報を使い、OpenAI API の Responses API や Chat Completions API として叩ける互換サーバーを実装してみました。Codex の利用方法の一つである、ChatGPT サブスクリプションでの定額利用範囲でも使えるのが嬉しいですね。Codex で認証済みの環境なら、uvx コマンド1つで互換サーバを起動できます。

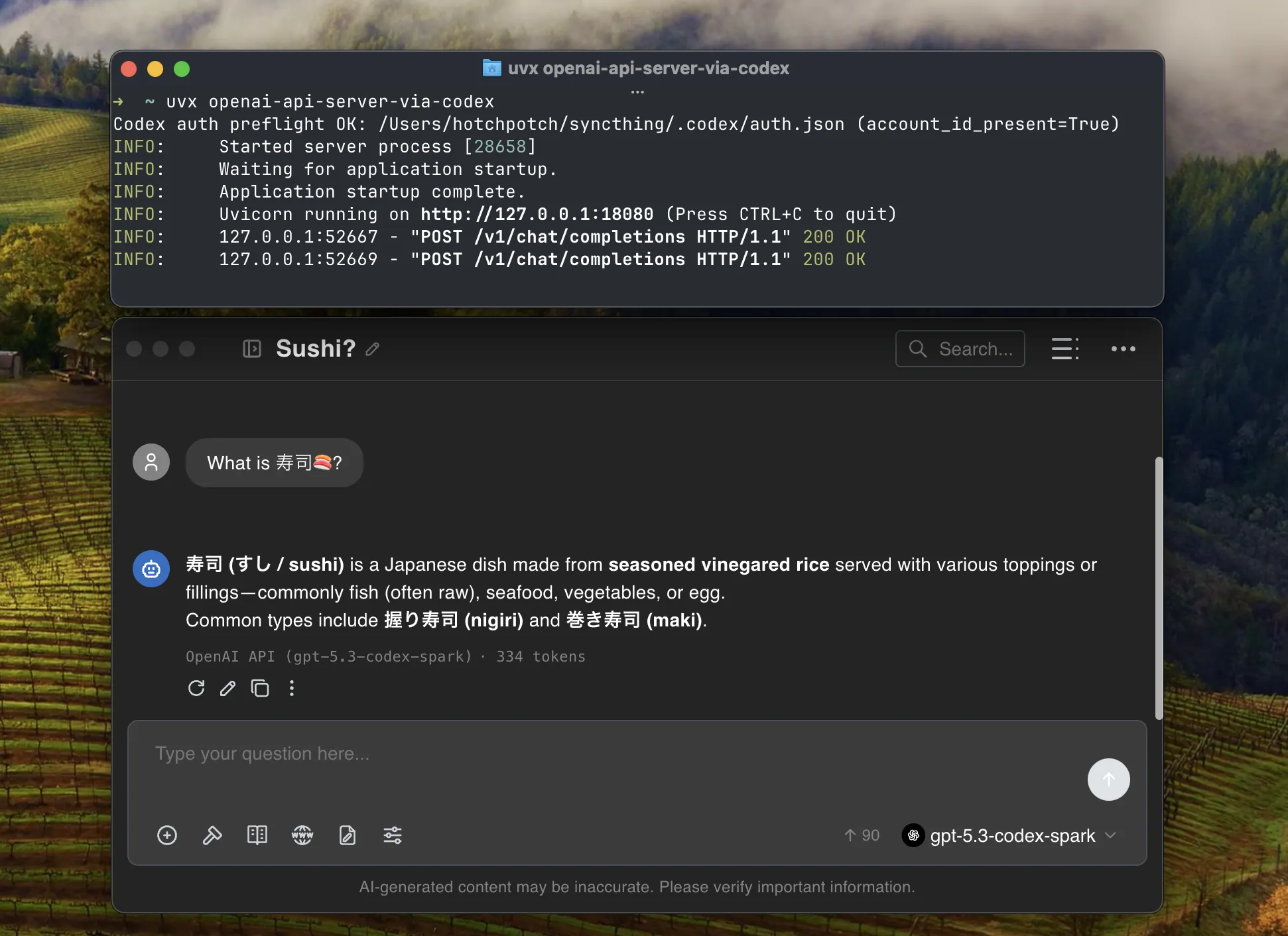

uvx openai-api-server-via-codexこれでローカルにサーバーが立ち上がります。デフォルトでは http://127.0.0.1:18080 で待ち受け、OpenAI API を叩けるクライアントから、/v1/responses や /v1/chat/completions のエンドポイントが利用できるようになります。ライブラリ経由で API を叩きたいときに便利ですね。

例えば、起動した環境に適当な OpenAI API に対応している GUI クライアントを使ってみるとこんな感じです。ChatGTP Pro サブスクリプションでは Codex から今現在(2026年5月7日)、gpt-5.3-codex-spark が使えるので、以下のスクリーンショットでは試しに使ってみています。

どのように実現しているの?

この方法は、OpenClaw が Codex を経由で処理するときに利用しているエージェント実行エンジンの一つ、Piでも行われている方法で、認証は Codex の情報を利用しつつ、https://chatgpt.com/backend-api/codex の Codex 用 API エンドポイントを叩いています。

この API エンドポイントを勝手に使って良いかは不明だったのですが、Simon Willison 氏の記事 A pelican for GPT-5.5 via the semi-official Codex backdoor API を読むと、どうやら利用してもよさそう(semi-official とは言い得て妙ですね)な雰囲気なので作ってみました。

注意事項

このプロジェクトは OpenAI 公式のAPI ではありません。あくまで、自身が利用権限を持つ Codex の認証情報を使い、ローカルなどの開発環境で OpenAI API 互換の形に変換するものです。次のような用途に利用すると、OpenAI の利用規約に抵触する場合があります。

- ChatGPT / Codex の利用制限を回避する目的で使う

- 自分以外の人に API として提供する

- サブスクリプションを再販・共有する

- 公開 API や第三者向けサービスのバックエンドとして使う

- Codex の認証情報やトークンを他人と共有する

また、Codex backend の仕様は予告なく変更される可能性があります。動作していたリクエスト形式やモデル名が突然使えなくなることもあり得ます。

Codex, ClaudeCode サブスクの2社のスタンスの違い

ClaudeCode が、OpenClaw などでのサブスクション契約での利用禁止が、2026年4月に通達されましたが、反対に Codex では、Codex App ServerやCodex SDKが公開されるなど、少なくとも今今はサブスクでも幅広く使ってもらうための仕組みを提供し始めており、両者のスタンスが反対で興味深いですね。

Anthropic 社はClaude向けの推論リソースが現状カツカツな感じがするので厳しく制限していることに対し、OpenAI 社はリソースが余っているのか、割と大盤振る舞いな雰囲気を感じています。ただ、OpenAI 社もリソースが厳しくなる・競争が無くなると将来的には厳しくなる・サブスクが無くなる可能性も十分にあり得ると思うので、今後どうなることやら、未来は読めませんね。